HEVECOMIA DES outils 100 % sur-mesure adaptés à vos besoins avec une Sécurité maximale et conformité RGPD / AI ACT

L'intelligence artificielle éthique et responsable pour les PME en 2026

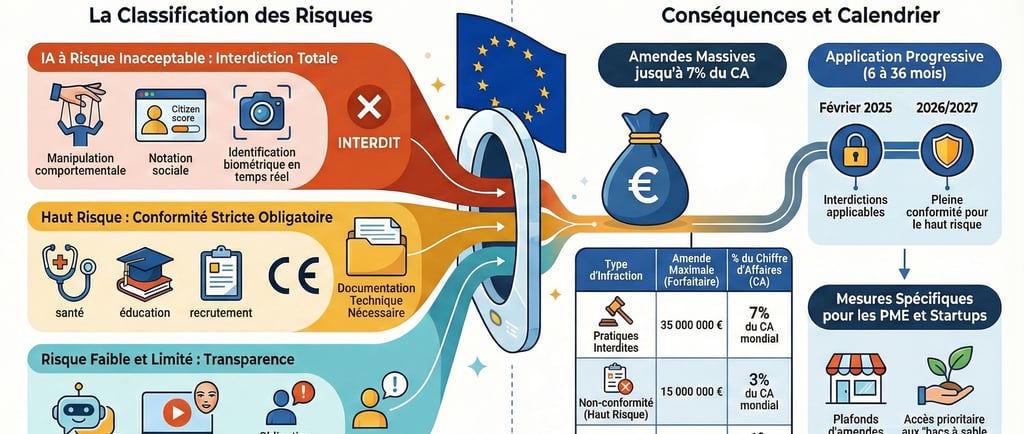

L'IA Act repose sur une approche dite « par les risques » : plus le risque généré par le système d'intelligence artificielle est élevé pour la santé, la sécurité ou les droits fondamentaux des personnes, plus les règles à respecter sont strictes,,. Ce règlement classe les systèmes d'IA selon quatre niveaux principaux de risques, auxquels s'ajoute une catégorie spécifique pour les modèles d'IA à usage général.

Hevecomia - Véronique Huret

2/10/202614 min read

L’IA Act : Ce que vous devez absolument savoir sur la première grande loi mondiale sur l’intelligence artificielle

1. Introduction : Le réveil d'un géant réglementaire

Le 1er août 2024 marque un séisme dans l'écosystème numérique mondial : l'entrée en vigueur de l'IA Act (Règlement UE 2024/1689). Plus qu'une simple liste de contraintes, ce texte s'affirme comme un véritable "market shaper". Pour les innovateurs et les dirigeants, il ne s'agit plus seulement de gérer de la donnée, mais de naviguer dans une asymétrie réglementaire complexe où la sécurité juridique devient un actif stratégique.

L'Europe tente ici un pari historique : transformer la protection des droits fondamentaux en un levier de compétitivité. Mais attention, si le texte est entré en vigueur, son application est une course de fond. Le calendrier de mise en œuvre est progressif, s'étalant sur 36 mois :

• Février 2025 (6 mois) : Interdiction des systèmes à risque inacceptable.

• Août 2025 (12 mois) : Entrée en vigueur des règles pour l’IA à usage général (GPAI) et de la gouvernance.

• Août 2026 (24 mois) : Application de la majorité des obligations pour les systèmes à haut risque.

• Août 2027 (36 mois) : Mise en conformité des systèmes à haut risque déjà régulés par d'autres textes sectoriels.

2. Le concept de « risque inacceptable » : Quand l'IA franchit la ligne rouge

L'IA Act segmente le marché selon une pyramide des risques. Au sommet, certaines pratiques sont jugées incompatibles avec les valeurs démocratiques et sont, à ce titre, strictement proscrites :

• La notation sociale (Social Scoring) : Interdiction de classer les individus selon leur comportement social, sauf dans le cadre de pratiques d'évaluation licites et spécifiques prévues par la loi.

• La manipulation cognitive subliminale : Tout système visant à altérer le comportement d'une personne pour lui causer un préjudice.

• L'exploitation des vulnérabilités : Le ciblage fondé sur l'âge, le handicap ou la situation socio-économique.

• L’identification biométrique à distance en temps réel : Proscrite dans les espaces publics, sauf pour des exceptions impérieuses de sécurité publique (menace terroriste réelle et prévisible, recherche de victimes).

• L'inférence des émotions : Interdite sur le lieu de travail et dans les établissements d'enseignement.

« Un usage à risque inacceptable désigne un système d'IA dont le déploiement est considéré comme contraire aux valeurs fondamentales de l'UE, car il présente un risque clair de manipulation, de discrimination ou de violation des droits fondamentaux. »

3. L’effet « Bruxelles » : Pourquoi le monde entier est concerné

Le périmètre d'application de l'IA Act dépasse largement les frontières de l'Union. Par son caractère extraterritorial, la loi capture toute entreprise — qu'elle soit basée à San Francisco ou Shenzhen — dès lors que la sortie (output) de son système d'IA est utilisée dans l'UE.

Cette régulation crée une distinction fondamentale entre le Fournisseur (Provider), qui développe le modèle, et le Déployeur (Deployer), qui l'utilise à titre professionnel. Pour les acteurs internationaux, le marquage CE devient le "passeport" obligatoire pour accéder au marché européen, imposant de facto les standards de l'UE au reste du monde, à l'image du précédent créé par le RGPD.

4. Le facteur « ChatGPT » : La régulation des modèles à usage général (GPAI)

L'émergence fulgurante des LLM a forcé le législateur à introduire une catégorie spécifique pour les modèles d'IA à usage général (GPAI). Le pivot de cette section est le seuil technique de 10^25 FLOPS (opérations flottantes) utilisé lors de l'entraînement, définissant les modèles à "risque systémique".

Ces modèles de haute capacité, comme GPT-4 ou Gemini, tombent sous la supervision directe du nouveau Bureau de l'IA (AI Office). Ce dernier peut d'ailleurs mettre à jour ce seuil en fonction de l'évolution technologique ou du nombre d'utilisateurs professionnels. Les obligations incluent des tests d'adversité (red teaming) et une cybersécurité renforcée. Un point de friction majeur subsiste pour les créateurs : l'obligation pour les fournisseurs de respecter le droit d'auteur, incluant le droit d'opt-out des ayants-droit pour la fouille de données.

Modèles ouverts vs fermés : La loi tente de préserver l'innovation ouverte en offrant un régime allégé aux modèles sous licence libre. Toutefois, cette exemption s'évapore dès lors que le modèle est considéré comme présentant un risque systémique ou s'il est intégré dans un système classé "à haut risque". La transparence sur les résumés des données d'entraînement reste une obligation universelle, quel que soit le mode de distribution.

5. Des sanctions qui donnent le vertige : Un arsenal coercitif calibré

La sévérité des sanctions souligne la volonté politique de faire respecter ce cadre. Au-delà des amendes, les autorités de surveillance peuvent ordonner le retrait pur et simple d'un produit du marché.

L’échelle des amendes se décline ainsi :

• Jusqu'à 35 000 000 € ou 7 % du chiffre d'affaires mondial annuel pour le non-respect des interdictions (risques inacceptables).

• Jusqu'à 15 000 000 € ou 3 % du chiffre d'affaires pour le non-respect des obligations liées aux systèmes à haut risque ou aux modèles GPAI.

• Jusqu'à 7 500 000 € ou 1 % du chiffre d'affaires pour la fourniture d'informations inexactes ou trompeuses aux régulateurs.

Le bouclier pour les PME : Pour ne pas étouffer les startups, le législateur a instauré une logique inverse : pour les PME, l'amende sera plafonnée au montant le moins élevé entre le pourcentage et le chiffre fixe.

6. L’innovation sous surveillance : Le pari des « Bacs à sable » réglementaires

Pour contrebalancer la pression réglementaire, l'UE impose aux États membres la création de bacs à sable réglementaires (regulatory sandboxes). Ces laboratoires juridiques permettent aux entreprises de tester leurs innovations en conditions réelles sous la supervision des autorités nationales compétentes, offrant une "zone de sécurité" avant la commercialisation.

Pour les systèmes à Haut Risque (santé, infrastructures, recrutement), le chemin vers la conformité est exigeant. Il nécessite un processus en 10 étapes, incluant le marquage CE, la mise en place d'un système de gestion de la qualité et, pour certains acteurs, une Analyse d'Impact sur les Droits Fondamentaux (FRIA). L'enjeu est de transformer cette conformité en un "sceau de confiance" pour les utilisateurs finaux.

7. Conclusion : Vers une IA de confiance ou un frein à l'innovation ?

L'IA Act pose les jalons d'une souveraineté numérique européenne fondée sur l'éthique. Si des voix comme Amnesty International s'inquiètent de certaines lacunes sur la protection des migrants, et que des organisations de créateurs dénoncent un manque de fermeté sur le copyright, le texte reste une prouesse de compromis politique.

Introduction à l'IA Éthique pour les PME en 2026

À l'horizon 2026, l'intelligence artificielle (IA) éthique et responsable est devenue une préoccupation majeure pour les petites et moyennes entreprises (PME). Alors que les technologies d'IA continuent de progresser à un rythme rapide, l'intégration de principes éthiques dans leur développement et leur utilisation est cruciale. L'éthique en IA ne concerne pas uniquement le respect des lois en vigueur; elle englobe aussi la responsabilité sociale des entreprises et le respect des valeurs humaines fondamentales.

Les PME, souvent considérées comme les piliers de l'économie, jouent un rôle central dans l'adoption de pratiques d'IA éthiques. L'importance accrue de ces valeurs dans le développement technologique est liée à la nécessité de bâtir la confiance des consommateurs. En effet, avec l'augmentation de l'utilisation d'outils basés sur l'IA, les clients sont de plus en plus préoccupés par la manière dont leurs données sont manipulées et par l'éventualité de biais intégrés dans les algorithmes. Pour les PME, qui tentent de se démarquer dans un marché concurrentiel, l'adoption d'une stratégie d'IA éthique peut constituer un avantage décisif.

Il est essentiel de reconnaitre que l'IA éthique n'est pas une option, mais une obligation dans un environnement commercial où la transparence et la responsabilité sont désormais attendues par les consommateurs. De nombreuses PME commencent à mettre en place des cadres d'éthique de l'IA qui visent à garantir que leurs solutions technologiques sont non seulement efficaces mais aussi justes et respectueuses des droits des individus. Ce faisant, elles s'assurent une pérennité non seulement sur le plan économique mais aussi sur celui de la responsabilité sociale.

Les Fondements de l'Éthique de l'IA

L'éthique de l'intelligence artificielle repose sur plusieurs principes fondamentaux qui sont particulièrement importants pour les petites et moyennes entreprises (PME). La première notion clé est la responsabilité, qui exige que les entités qui développent ou utilisent des systèmes d'IA soient conscientes des impacts de leurs décisions technologiques. Cela implique une démarche proactive pour évaluer les conséquences de l'introduction de l'IA dans leurs opérations, tant sur le plan social qu'économique.

Un autre pilier de l'éthique de l'IA est la transparence des algorithmes. Afin de favoriser la confiance des utilisateurs et des parties prenantes, les PME doivent s'assurer que les mécanismes de décision de leurs systèmes d'intelligence artificielle sont compréhensibles. Cela signifie qu'il est essentiel de documenter et de communiquer clairement comment des données sont utilisées, comment les algorithmes fonctionnent, et sur quelle logique reposent les recommandations ou les décisions prises par ces systèmes.

Enfin, l'alignement des systèmes d'IA avec les valeurs humaines est un principe essentiel. Les PME doivent veiller à ce que leurs applications d'intelligence artificielle reflètent et respectent les valeurs éthiques de leur communauté et des normes sociétales. Cela peut inclure des considérations sur l'équité, la non-discrimination, et la protection de la vie privée. En intégrant ces principes dans leur stratégie d'IA, les PME pourront non seulement éviter des écueils éthiques, mais aussi améliorer leur image de marque et favoriser un rapport de confiance avec leurs clients et employés.

La Lutte contre les Biais Algorithmiques et le Respect de la Vie Privée

L'émergence de l'intelligence artificielle (IA) dans les petites et moyennes entreprises (PME) pose un défi majeur en matière de biais algorithmiques. Les biais, qui peuvent survenir lorsqu'un algorithme est formé sur des ensembles de données biaisés, peuvent entraîner des résultats discriminatoires. Par exemple, des systèmes de recrutement basés sur l'IA ont été critiqués pour leur tendance à favoriser certains groupes démographiques tout en désavantageant d'autres, comme les femmes ou les minorités ethniques. Ce phénomène n'est pas seulement une question d'éthique; il affecte également la réputation des entreprises et leur conformité avec la législation en matière de discrimination.

En parallèle, la protection de la vie privée est devenue une préoccupation primordiale pour les PME qui utilisent des systèmes d'IA. Le règlement général sur la protection des données (RGPD) impose des exigences strictes sur la manière dont les données personnelles doivent être collectées, traitées et conservées. Les PME doivent naviguer avec précaution dans ces règles afin d'éviter des amendes significatives et de maintenir la confiance de leurs clients. Par exemple, une entreprise qui utilise des outils d'IA pour analyser les comportements des consommateurs doit s'assurer qu'elle dispose du consentement explicite des utilisateurs pour traiter leurs données.

Il est essentiel pour les PME de s'engager dans une démarche proactive pour identifier et atténuer les biais algorithmiques tout en respectant les exigences du RGPD. Cela peut inclure des audits réguliers des systèmes d'IA, des formations pour les employés sur les enjeux de l'éthique numérique, ainsi que la mise en œuvre de politiques robustes de protection des données. En abordant ces défis de manière proactive, les PME peuvent tirer parti des avantages de l'IA tout en respectant les droits de la personne et en renforçant leur position sur le marché.

La Conformité avec la Réglementation : RGPD et AI Act Européen

Dans le paysage réglementaire actuel, les petites et moyennes entreprises (PME) doivent naviguer à travers un cadre législatif en constante évolution, particulièrement en ce qui concerne l'intelligence artificielle (IA). Les réglementations comme le Règlement Général sur la Protection des Données (RGPD) et le nouvel AI Act européen jouent un rôle crucial dans l’adoption de ces technologies par les PME. Ces lois visent à protéger les droits des citoyens tout en promouvant l’innovation.

Le RGPD, en vigueur depuis mai 2018, empêche les entreprises de traiter les données personnelles sans le consentement explicite des individus concernés. Pour les PME, conformer leurs pratiques d'IA aux exigences du RGPD signifie qu'elles doivent établir des procédures claires pour la collecte, le stockage, et l'utilisation des données. Cela inclut également la mise en place de mesures de sécurité adéquates pour protéger les données sensibles, tout en garantissant aux clients des droits d'accès, de rectification et d'effacement de leurs informations personnelles.

En parallèle, l'AI Act européen, qui devrait entrer en vigueur dans les prochaines années, vise à réguler l'utilisation de l'intelligence artificielle à travers le continent. Cette législation introduira des normes pour classifier les systèmes d'IA en fonction de leur niveau de risque, imposant des obligations spécifiques sur les applications à haut risque. Pour les PME, cela nécessite une compréhension approfondie des implications de chaque technologie d'IA adoptée et comment les aligner sur les normes établies. La non-conformité expose non seulement les entreprises à des amendes, mais aussi à une perte de confiance de la part des clients, ce qui peut avoir des conséquences significatives sur leur réussite.

Adopter une Approche Éthique de l'IA en PME

Pour les petites et moyennes entreprises (PME) qui souhaitent intégrer l'intelligence artificielle (IA) de manière responsable, il est essentiel d'adopter une approche éthique. Cela implique l'élaboration de stratégies claires et l'application de bonnes pratiques qui garantissent que l'utilisation de l'IA se fait dans le respect des valeurs humaines et des droits des individus.

Tout d'abord, il conviendrait d'encourager la formation des employés sur les implications éthiques de l'IA. Organiser des ateliers ou des séminaires peut avoir un impact significatif sur la compréhension des usages responsables de cette technologie. Une culture d’entreprise qui valorise l’éthique contribuera à une adoption réussie de l’IA.

Ensuite, il est nécessaire d'inclure des critères éthiques dès le départ dans le processus décisionnel. Cela peut être réalisé en formant une équipe dédiée à l'IA éthique, composée de membres de divers départements de l'entreprise. Cette équipe pourra avoir pour mission de mener des audits réguliers sur les pratiques d'utilisation de l'IA et d'assurer la conformité avec les normes éthiques établies.

En outre, les PME devraient envisager de développer des lignes directrices spécifiques sur l'usage de l'IA. Ces lignes directrices peuvent aborder des sujets tels que la protection des données, la transparence des algorithmes, et la lutte contre les biais discriminatoires. Le fait de documenter ces principes aidera à établir un cadre éthique solide qui guidera les décisions futures.

Enfin, il est impératif de favoriser la transparence vis-à-vis des clients et des partenaires. Informer les parties prenantes sur la manière dont l'IA est utilisée au sein de l'entreprise peut servir à renforcer la confiance et à encourager une interaction positive. Adopter ces stratégies permettra non seulement d'assurer une utilisation éthique de l'IA, mais également d'engendrer une perception favorable de l'entreprise dans son secteur d'activité.

Exemples de Bonnes Pratiques en IA Responsable

Dans le contexte actuel, de nombreuses petites et moyennes entreprises (PME) adoptent des méthodes responsables pour intégrer l'intelligence artificielle (IA) dans leurs opérations. Ces PME démontrent que l'éthique de l'IA ne se limite pas à des concepts théoriques, mais peut être mise en pratique de manière tangible et bénéfique.

Par exemple, une PME dans le secteur de la santé a développé un système d'IA pour aider à la prise de décisions cliniques. En intégrant des mécanismes de transparence, cette entreprise a veillé à ce que les médecins puissent comprendre comment les algorithmes parviennent à leurs conclusions. La combinaison d’analyses de données et de l’expertise humaine permet d'augmenter la confiance des professionnels de la santé dans l’utilisation des recommandations suggérées par le système. Cela démontre que l’explicabilité des algorithmes est essentielle, surtout dans des domaines sensibles comme la santé.

Une autre PME, spécialisée dans le marketing numérique, a mis en œuvre un modèle d’IA qui analyse le comportement des consommateurs. Toutefois, au lieu d’automatiser entièrement le processus décisionnel, l’entreprise conserve un contrôle humain sur les recommandations générées par l'IA. Ce contrôle humain permet d'ajuster les actions entreprises en fonction des retours clients, tout en maintenant une approche éthique et responsable de l'IA. En rendant ce processus aussi participatif que transparent, elle assure une conformité avec les attentes éthiques et favorise une relation de confiance avec ses clients.

Ces exemples illustrent non seulement la faisabilité de l'intégration de l'IA dans des pratiques éthiques et responsables, mais également comment les PME peuvent tirer profit de l'innovation sans compromettre leurs valeurs. Grâce à des initiatives telles que la transparence et le contrôle humain, les PME sont en mesure de naviguer efficacement dans le monde complexe de l'intelligence artificielle.

Avec l'AI Act, un certain nombre de mesures sont mises en place pour s'assurer que l'on respecte un ensemble de critères éthiques associés à la gestion des risques, la gouvernance des données, la documentation technique, la traçabilité, la supervision humaine, l'évaluation de la robustesse, l'exactitude, la cybersécurité des systèmes d'IA et la mise en place d'un système de management de la qualité.

Mais l'AI Act n'est pas la seule mesure mise en place par l'UE sur l'IA de confiance.

Avec le programme pour une Europe numérique,elle cofinance avec les États membres, dont la France, des Testing and Experimentation Facilities for AI (TEF) avec un budget supérieur à 300 millions d’euros.

De large consortiums de 40 à 60 acteurs de l'IA de confiance, notamment des centres d'essais, des organismes de certification, des organismes de normalisation et des living labs sont impliqués dans l’initiative.

L'objectif de ces TEF est de fournir aux PME, ETI et groupes industriels européens l'ensemble des outils nécessaires pour l’évaluation des systèmes d’IA en phase de mise au point des IA et donc au service des développeurs de technologies intelligentes.

Quelles sont les sanctions de l'« AI Act » ?

Les sanctions prévues par l'AI Act vont de 1 % à 7 % du chiffre d’affaires annuel mondial de l’entreprise ou déterminées à partir de montants seuils allant de 7,5 à 35 millions d’euros d’amende.

Le niveau de l’amende varie selon la nature de la non-conformité (non-respect des usages interdits, manquement aux exigences pour les applications à haut risque, ou non-conformité aux exigences de transparence pour les risques limités mais spécifiques) et la catégorie de l’entreprise.

Quelles sont les répercussions de l'IA sur le marché du travail européen et l'impact de l'« AI Act » sur la compétitivité des entreprises ?

L'IA représente une opportunité unique de progrès économique et de bien-être social.

D'une part, elle peut contribuer à réduire les tâches pénibles physiquement ou rébarbatives. Et d'autre part, elle peut améliorer la compétitivité des entreprises françaises.

Hevecomia : Engagement pour une IA Responsable et Conforme

L'équipe Hevecomia se positionne comme un acteur clé dans l'initiative de promouvoir une intelligence artificielle éthique et responsable, spécialement conçue pour répondre aux besoins des petites et moyennes entreprises (PME). L'entreprise s'engage à fournir des solutions d'IA qui respectent non seulement les normes légales mais également les principes éthiques, favorisant un environnement de confiance entre les entreprises et leurs clients.

Une de leurs initiative phare, le plan "Osez l'IA", a été élaboré pour encourager les PME à adopter des technologies d'intelligence artificielle tout en garantissant qu'elles le font de manière conforme. Ce plan inclut une série de ressources éducatives, de formations et d'accompagnements personnalisés pour aider les entreprises à naviguer dans les complexités de l'IA. Les PME peuvent ainsi non seulement bénéficier des avantages de l'IA, mais également le faire sans compromettre leur intégrité éthique ou se heurter à des difficultés juridiques.

En outre, l'équipe d'Hevecomia travaille en étroite collaboration avec diverses institutions financières pour offrir des options de financement adaptées aux PME. Cette initiative vise à éliminer les obstacles financiers qui peuvent empêcher les PME d'investir dans des solutions intelligentes et responsables. Grâce à des stratégies de financement innovantes, les petites entreprises peuvent accéder aux technologies d'intelligence artificielle sans surcharger leur budget, permettant ainsi une transformation digitale progressive et durable.

Avec ces initiatives, l'équipe d'Hevecomia démontre son engagement en faveur d'une intelligence artificielle qui non seulement favorise l'innovation mais également consolide la confiance dans le cadre des affaires. En adoptant des pratiques responsables et conformes, les PME peuvent se positionner favorablement dans une économie numérique en constante évolution.

© 2026. All rights reserved.